DIVULGACIÓN CIENTÍFICA

Pensar la inteligencia artificial

¿Qué es? ¿Cómo funciona? ¿Cuáles son sus aplicaciones? Estos y otros interrogantes son abordados, desde distintas aristas de la ciencia, por especialistas del CONICET.

Su origen se remonta a la segunda guerra mundial cuando se comenzó a investigar cómo las máquinas podían simular la inteligencia y se la llamó por primera vez Inteligencia Artificial (IA) a mediados de la década del ‘50.

En la actualidad, las inteligencias artificiales están presentes en muchas situaciones de la vida cotidiana, pero ¿de qué se habla cuando se habla de inteligencia artificial? Especialistas en ciencia de datos, neurociencia e ingeniería aportan su análisis y reflexión en torno a esta disciplina.

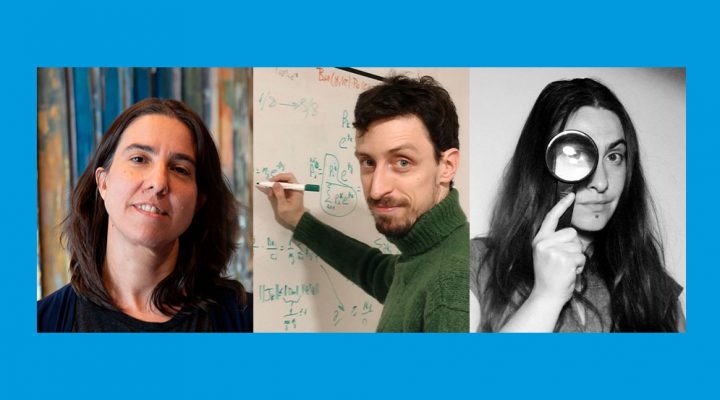

Laura Ación es doctora en bioestadística e investigadora del CONICET en el Instituto de Cálculo Rebeca Cherep de Guber (IC, CONICET-UBA. Allí formó el Co-Laboratorio Multidisciplinario de Ciencia de Datos e Inteligencia Artificial, cuyo principal tema de estudio es el uso responsable de datos, incluyendo el diseño de herramientas responsables de Inteligencia Artificial y Ciencia de Datos, Ciencia Abierta, Ética y reproducibilidad en investigación.

Andrea Goldin es bióloga y doctora en ciencias fisiológicas. Como investigadora del CONICET trabaja en el Laboratorio de Neurociencia de la Universidad Torcuato Di Tella y se especializa en neurociencia educacional, una rama de la neurociencia que trata de entender cómo podemos enseñar y aprender mejor, teniendo en cuenta cómo funciona el cerebro.

Matias Vera es doctor en ingeniería y becario del Consejo en el Centro de Simulación Computacional para Aplicaciones Tecnológicas (CSC, CONICET) y se especializa en los algoritmos de aprendizaje popularmente conocidos como inteligencia artificial.

¿Qué es la Inteligencia Artificial (IA)?

La IA es una disciplina dentro de las Ciencias de la Computación que abarca muchos temas. “Esta disciplina se encarga de estudiar cómo hacer tareas que hacemos las personas a través de recetas (que también llamamos algoritmos) para que las pueda hacer una máquina”, explica Ación.

“Se trata de “programas informáticos diseñados para imitar la inteligencia humana y realizar tareas de manera autónoma”, define Vera, y puntualiza que “lo que actualmente se reconoce como IA son algoritmos de aprendizaje automático”.

Si de algoritmo se trata

“¡Hay muchos nombres para la misma cosa!”, indica Ación para referirse a “lo que conocemos como algoritmo, no es otra cosa que un resumen o receta. Esta receta, luego la podemos usar para que nos informe sobre situaciones similares”.

“Uno le muestra a la IA muchos ejemplos de qué tiene que hacer en diversos casos, llamados datos de entrenamiento, -precisa Vera- para que luego ésta aprenda qué hacer en casos no necesariamente vistos”. Según el becario, se trata de un aprendizaje basado en cuentas matemáticas, que se nutre de datos de entrenamiento, por lo que su creatividad sólo puede limitarse a combinar patrones ya vistos.

Por su parte, Goldin lo plantea como “una receta, una serie de pasos muy explícitos que se deben seguir a rajatabla para obtener los resultados esperados. En ese sentido, las computadoras ejecutan algoritmos, pero las personas también, por ejemplo, al seguir una receta de cocina nueva, al ejecutar exactamente el camino que nos da un GPS o al aplicar el método de división que nos enseñaron en la escuela”.

¿Qué es ChatGPT?

“ChatGPT es lo que se conoce como un bot -señala Ación- una herramienta de IA basada en datos que es capaz de generar texto escrito en forma de diálogo, como un chat”. Y apunta “habla muy bien, sin faltas de ortografía, con muy buena redacción. Es un gran charlatán, tan bueno, que es fácil creer sus respuestas”.

En ese sentido, Goldin especifica que “si bien esta tecnología ya existía, lo que empezaron a hacer ahora estas nuevas interfaces de chat es usar un lenguaje que hace parecer que te habla un humano y le hablas a un humano”.

Sin embargo, aclara Ación, “todo lo que Chat GPT imprime en pantalla es un poco como el pronóstico de si va a llover o no mañana: algunas veces acierta, otras no”. Además, la científica pone el foco en el impacto ambiental de entrenar este tipo de herramientas: “Hay voces expertas advirtiendo que, en medio del cambio climático en el que vivimos, es necesario restringir los recursos energéticos que usa este tipo de IA”. Por estas razones, lo considera “una herramienta de baja calidad que no debería estar disponible para el uso libre aún”.

Los Sí y los No en el avance de la IA

Para Vera, “las IAs están penetrando en casi todos los trabajos actuales. Así como con la revolución industrial o con la popularización del internet, la concepción de los trabajos cambió radicalmente, parecería que con las IAs está volviendo a pasar”. El científico pone el foco en los “avances significativos en sectores como la medicina, la industria, el transporte y las finanzas, mejorando la precisión de diagnósticos médicos, optimizando la eficiencia de la producción, permitiendo vehículos autónomos y facilitando el análisis de datos financieros”. Por su parte, Ación plantea que “estas herramientas de IA de moda son solo un área pequeña del mundo completo de la IA y lo que estamos viendo es solo una campaña de marketing colosal que está afectando seriamente el avance de otros temas de investigación en IA con mucho más potencial a futuro”.

Controversias en torno a IA

“La controversia que a mi me parece importante -valora Goldin- tiene que ver con el origen de los datos que alimentan estos algoritmos, que después nos van a contestar cosas”. La investigadora pone énfasis en que “esos datos salen o de los países centrales o de empleados en países periféricos que son empleados precarizados, tercerizados -en general- y que, básicamente, responden lo que los empleadores de los países centrales esperan que respondan”. Y concluye: “Ahí hay un tema grave de perpetuar e incrementar las desigualdades y de hacer que, cada vez, el conocimiento sea más sesgado y tenga menos en cuenta a los países o regiones periféricas, como la nuestra”.

En la misma línea, Ación considera que “lo que estamos viviendo es una imposición de un puñado de grandes empresas tecnológicas que buscan maximizar sus ganancias sin miramientos de las consecuencias que eso pueda traerle al resto de la humanidad”. Y, a su vez, puntualiza otra controversia actual: “Los juicios en marcha, porque algunas de las herramientas de IA disponibles habrían usado datos para su entrenamiento sin respetar los derechos de autoría”.

En tanto, Vera propone algunos ejemplos: “En primer lugar, la discriminación y el sesgo algorítmico, ya que los modelos de IA pueden reflejar sesgos sociales o prejuicios existentes en los datos de entrenamiento; la privacidad y seguridad de los datos y el derecho de autor y, por último, el impacto en el empleo, porque se teme que la automatización pueda llevar a la pérdida de puestos de trabajo tradicionales”.

Peligros reales de la IA

“La principal falencia que tiene la IA, aplicada a la educación, es que no usa información verificada -indica Goldin-; lo que hace es completar la información con la/s palabra/s más probable/s. Entonces el problema que tiene es que muchas veces, por lo menos una parte de lo que dice, es incorrecto y eso, además de ser un problema, es bastante peligroso”, reflexiona la investigadora.

Vera, por otro lado, hace referencia a los sesgos algorítmicos que pueden inducir al usuario a tomar decisiones discriminatorias o injustas: “Es necesario que los que colaboramos en la creación de IAs seamos conscientes de esta posibilidad y evitemos que ocurra”.

“Los peligros reales de la IA, que está en boga estos días, no es que surja una super IA que nos domine como dicen algunas voces -clarifica Ación-, sino el daño que viene haciendo sobre nuestras sociedades, por adoptar herramientas de mala calidad, con el fin de que quienes la producen capitalicen grandes ganancias lo más rápido posible”.

¿Es posible una regulación en torno a la IA?

Al respecto, Ación contesta de forma categórica “¡Claro que se puede controlar y regular! Aunque las grandes empresas tecnológicas vienen convenciendo a los gobiernos más poderosos del mundo, a través de sus maquinarias de lobby y ríos de dinero, que se necesitan nuevas leyes”. Sin embargo, continúa la investigadora, “todos los días se violan leyes que ya tenemos y por las que ya se pueden controlar estas herramientas”. Y como corolario, prevé que “con la decisión política adecuada, algunas de las leyes que tenemos ya podrían actuar como resguardo, mientras nuestras democracias perfeccionan los controles y regulaciones, un proceso que no sigue los tiempos casi instantáneos de las grandes tecnológicas”.

Vera, a su vez, explicita: “Creo que algún tipo de regulación tiene que haber, sobre todo para tener garantías que datos personales no se usen para entrenar. En tanto “la distribución del trabajo sin dudas cambiará, como ocurrió con la revolución industrial o la popularización de internet, y es importante tener fuertes regulaciones durante la transición para que la desigualdad social no se incremente”.

¿Cómo puede la sociedad prepararse para este cambio?

Para Vera, “es importante no cerrarse a la posibilidad de usar estas herramientas, porque probablemente en el futuro serán esenciales”. Además, como docente promueve “fomentar la educación en ciencia de datos y aprendizaje automático en todos los niveles, desde la educación básica hasta la formación profesional”.

En el mismo sentido, Goldin cree que “lo que se está dando es una suerte de revolución pedagógica” y plantea “la necesidad de incorporar la IA, aprender a usarla y, entonces, repensar nuestras prácticas pedagógicas y cotidianas en este contexto”. Es por ello que, como educadora, comenzó a aplicar el uso del chat en sus clases, “porque me parece que hay que enseñar a usarlo, es una herramienta que van a tener nuestros estudiantes en el futuro, cuando salgan a la vida laboral y entonces me parece bueno aprovechar las instancias de clase”.

“Siendo más humanas y humanos que nunca antes -profundiza Ación- estudiando disciplinas de las ciencias sociales -tanto más antiguas que las ciencias de la computación-, exigiendo que sean disciplinas que tengan voz y voto en todos los ámbitos en donde se diseña, desarrolla, despliega, se busca aplicar o se regula la IA”.

La investigadora entiende que la IA no debería tener ninguna aplicación fuera de las ciencias de la computación sin la contribución sustancial de la o las disciplinas en donde se busca aplicar. En síntesis, concluye: “La IA es solo una herramienta que debe supeditarse al resto de las disciplinas, por lo que debemos prepararnos para trabajar cada vez más en ámbitos interdisciplinarios, aportando cada quien desde su campo del conocimiento, buscando entender cómo habla cada disciplina y respetándonos mutuamente”.

Laura Ación: los datos y su uso responsable

Buena parte de la investigación científica se nutre de datos, de los cuales se extrae información para sacar conclusiones. La bioestadista Laura Ación estudia el uso responsable de datos, que provienen de registros de historias clínicas electrónicas, en aplicaciones de IA. “Utilizarlos en forma responsable es difícil porque implica usarlos en forma ética, que respete la confidencialidad y la privacidad cuando sea necesario, que representen bien los fenómenos que se quieren estudiar, que otras personas interesadas en reproducir la investigación puedan reutilizarlos y reproducir esas conclusiones”, comenta la investigadora.

Ación, además, forma a personas científicas y técnicas en estas prácticas que cree deben partir de y estar contextualizadas en América Latina. Por estas razones, cofundó y codirige MetaDocencia, una organización sin fines de lucro que trabaja para que la producción, comunicación y aplicación de los saberes científicos y técnicos sean globalmente equitativos.

Andrea Goldin: educación y neurociencia

Andrea Goldin es bióloga y se dedica a estudiar la neurociencia educacional, en particular lo que se llama transferencia, que es “cómo lo que aprendemos en un ámbito, lo terminamos aplicando en un contexto diferente, cómo lo que aprendemos en un lugar lo aplicamos en otro, o eso que aprendemos con una persona lo aplicamos con otra” manifiesta la investigadora. Su línea principal de estudio es Mate Marote, un proyecto de investigación del CONICET de entrenamiento cognitivo para niños pequeños y, recientemente, adultos mayores.

Matías Vera: aprendizaje espurio de las inteligencias artificiales

El ingeniero electrónico Matías Vera investiga el aprendizaje espurio de las inteligencias artificiales y cómo evitarlo. Los algoritmos más populares actualmente aprenden por medio del reconocimiento de patrones. Para explicarlo, ejemplifica “si se quiere hacer un reconocedor de imágenes de vacas y camellos, hay que mostrarles muchas fotos de vacas y camellos para que luego, dada una imagen nueva, la IA decida si es vaca o camello”. Ahora bien, “muchas de las IAs tienden a equivocarse cuando uno le muestra una foto de una vaca en el desierto o un camello en la pradera, ya que en los ejemplos con los que aprendió mayormente las vacas están en la pradera y los camellos en el desierto”, cuenta Vera. Esto se denomina aprendizaje espurio, porque la IA está asociando el patrón equivocado (reconocen el fondo en lugar del animal). Con sus investigaciones busca evitar que estas IAs cometan errores perjudiciales,como, por ejemplo, inducir a su usuario a tomar decisiones racistas o machistas. “La tecnología es nueva y todavía queda un largo camino por recorrer”, sintetiza el científico.

Por Florencia Verrastro